Stable Diffusionはテキストや画像を元に、AIが画像を生成をしてくれる技術です。

Stable DiffusionをWeb UIで使えるようにしたものが「Stable Diffusion Web UI」で、操作が視覚的にわかりやすく、初心者の方でも簡単に画像生成ができます。

専門的な知識がない方でも記事通りに進めていけばインストールできるので、ぜひ参考にしてみてください。

- 初心者だからインストールできるか不安

- 画像生成AIで自分の好きな画像を作りたい

- Stable Diffusionの基本的な使い方がしりたい

Stable Diffusion Web UIとは?

Stable DiffusionをWeb UIで使えるようにしたツールです。

開発者の方がAUTOMATIC1111という名前のため、AUTOMATIC1111と呼ばれることも多いですが、ツールの名前は「stable-diffusion-webui」です。

プロンプトと呼ばれる命令文を入力するだけで、以下のような画像が簡単に作れます。

Stable Diffusion Web UIに必要なスペックは?

まず容量ですが、Stable Diffusion Web UIだけで約10GB必要です。

初回にモデル(約4GB)が含まれるため、それを除外すれと大体6GBですが、好きなモデルをダウンロードしていると簡単に10GB以上は超えます。

動作環境についてはグラボが重視されており、よく見かけるのはRTX 3060(VRAM12GB)以上です。

ただRTX 3060 Tiでも問題なく動作するので、私のPCスペックと同程度なら使えると思います。

1080×1920の画像を連続で生成するなどは厳しいかもしれません

| CPU | Intel(R) Core(TM) i7-12700 |

| GPU | NVIDIA GeForce RTX 3060 Ti(VRAM8GB) |

| メモリ | 32GB |

| ストレージ | SSD(1TB) |

なお、ローカル環境で使用が難しい方はクラウド環境を使う方法もあります。

基本有料+ローカルより導入が難しいですが、興味がある方はこちらもチェックしてみてください。

Stable Diffusion Web UIをインストールする手順

Stable Diffusion Web UIに必要なのは以下3つです。

- Python(3.10系)

- Git for Windows

- Stable Diffusion Web UI本体

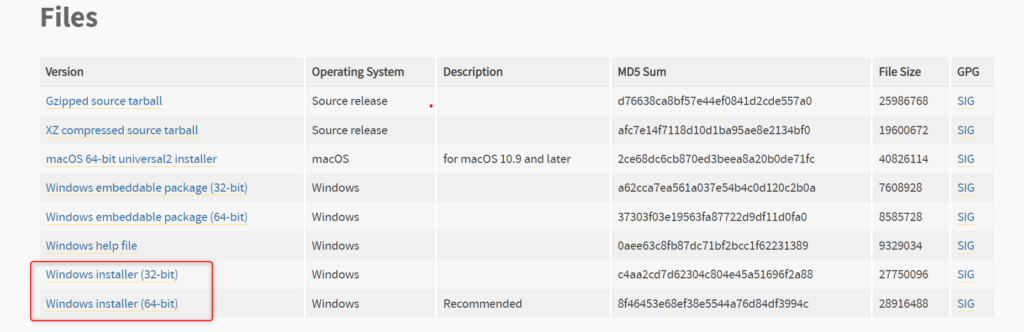

Python(3.10系)のインストール

Stable Diffusion Web UIはPythonで動かすため、Pythonをインストール必要があります。

推奨されているPythonのバージョンは3.10系です。

3.9だとVRAMの使用量を軽減できる機能が使えず、3.11だとインストール時にエラーが発生するという報告があります。

ですので、基本はPythonは3.10系を使いましょう。

24年1月現在、推奨されているバージョンは3.10.6です。

以下のURLからお使いの環境に合わせてインストーラーをダウンロードしてください。

https://www.python.org/downloads/release/python-3106/

Stable Diffusion Web UIのページからもダウンロードできます。(どちらも同じです)

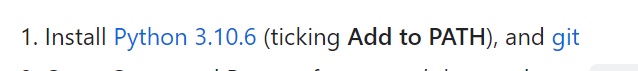

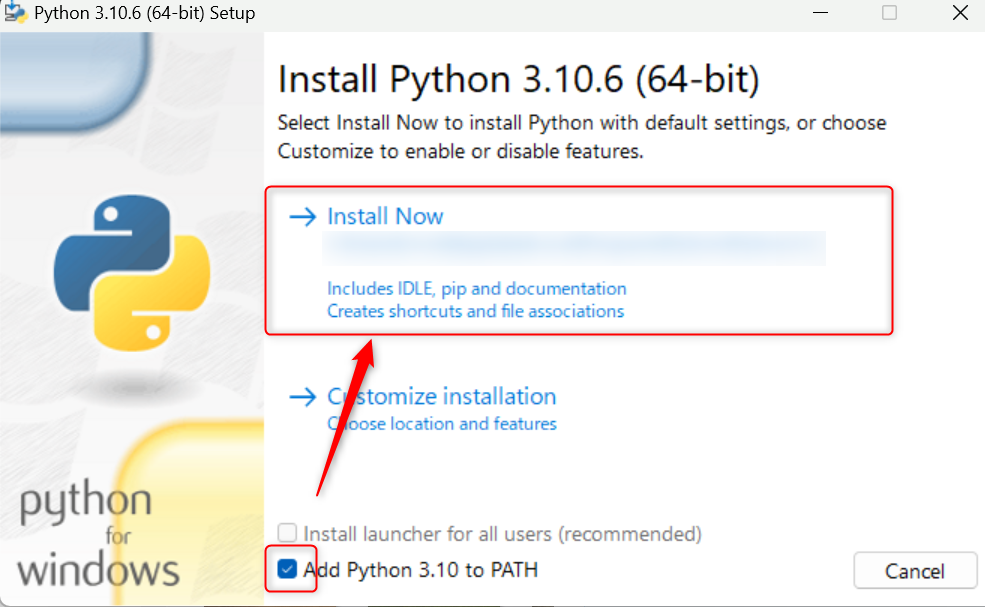

ダウンロードしたファイルを実行し、「Add python.exe to PATH」にチェックを入れて「Install Now」をクリックします。

自動的にインストールが始まるので、終わったら画面を閉じてPythonのインストールは完了です。

Git for Windowsのインストール

Git for windowsはWindows環境でGitを使うためのソフトウェアです。

長くなってしまうため詳細は省きますが、Githubなどで公開されているアプリケーションをインストールするためにGitが必要だとお考え下さい。

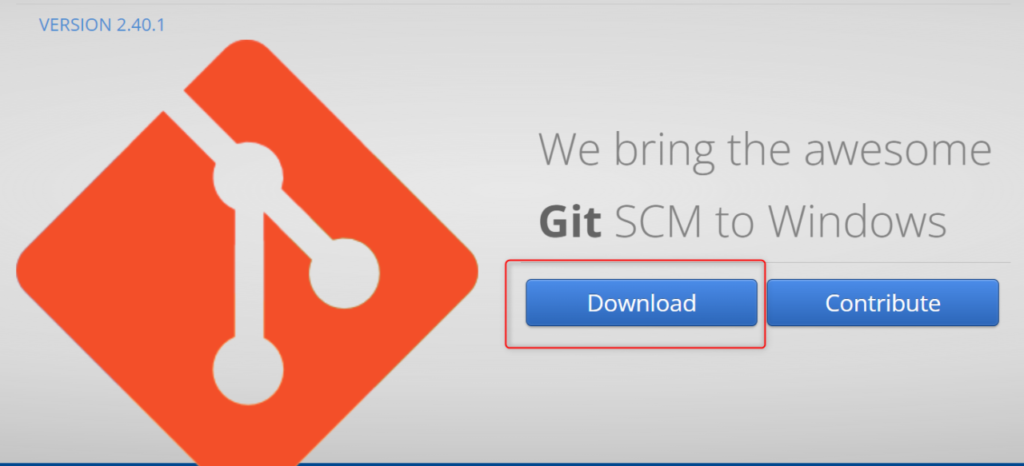

Git for windowsは以下URLの「Download」からダウンロードができます。

インストーラーを起動するといろいろ設定するウィンドウが表示されますが、全てそのまま「Next」で問題ありません。

最後の「View Release Notes」はブラウザで更新履歴が確認できるものなので、必要がなければチェックを外して「Finish」をクリックします。

これでGit for Windowsのインストール完了です。

Stable Diffusion Web UI本体のインストール

まずStable Diffusion Web UIをインストールしたいフォルダに行きます。

機能によってパスに日本語が含まれるとうまく動かないため、ドライブ直下など日本語が含まれない場所がおすすめです。

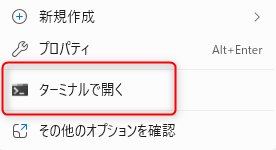

インストールしたい場所に移動し、フォルダの空白部分を右クリックして「ターミナルで開く」をクリックしてください。

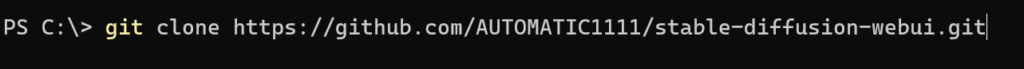

ターミナルが開いたら以下のコマンドを入力して、実行しします。

git clone https://github.com/Stable Diffusion Web UI/stable-diffusion-webui.git

「stable-diffusion-webui」というフォルダが作成されるので、中の「webui-user.bat」を起動します。

そうすると必要なファイルがダウンロードされ、自動的にStable Diffusion Web UIが開きます。

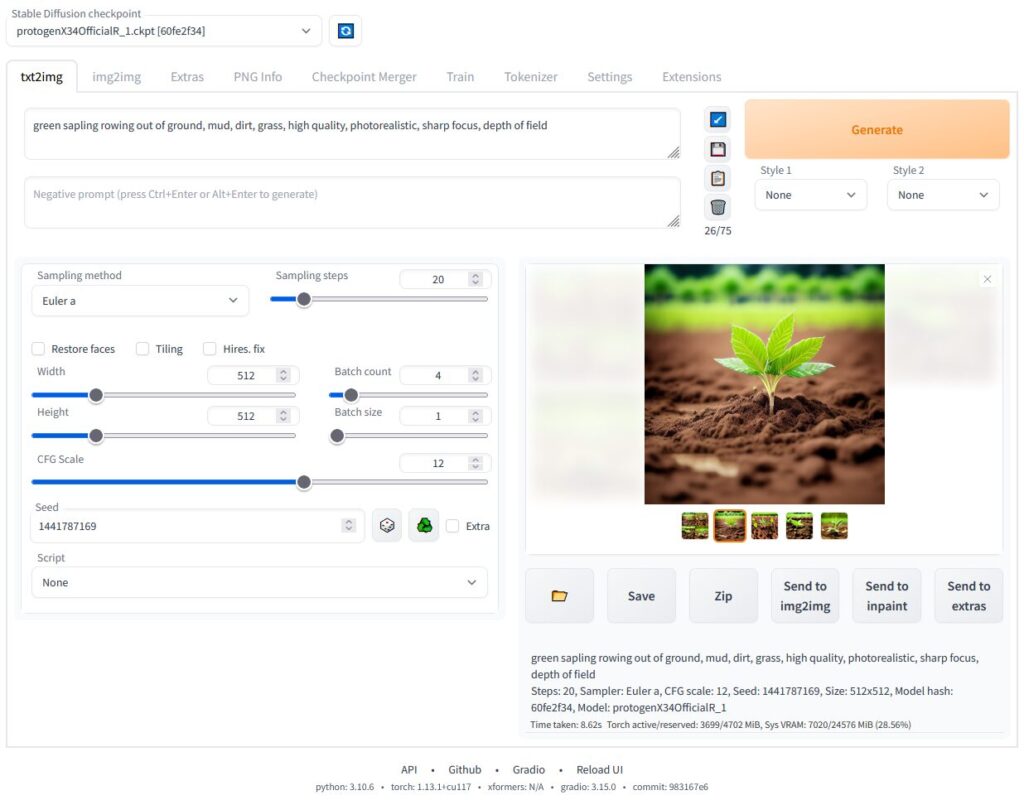

以下のような画面が開いたらインストール完了です。

なお、2回目以降も「webui-user.bat」起動で開けます。

Stable Diffusion Web UIの基本的な使い方

プロンプト・ネガティブプロンプトを入力して生成

とりあえずデフォルトのモデルで1回生成してみましょう。

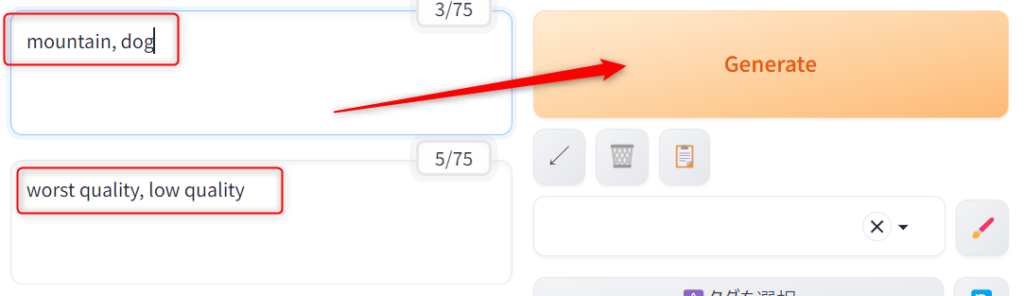

基本は英語でプロンプトを入力し、Generateボタンを押すだけです。

プロンプトは画像に対する命令文のようなもので、上の枠に反映させたい要素(プロンプト)、下の枠に反映させたくない要素(ネガティブプロンプト)を入力します。

例えば「山・犬」を生成したい場合は「mountain, dog」と単語をカンマで区切り、ネガティブプロンプトには「worst quality, low quality」などで低画質の画像が生成されないように指定します。

「Generate」を押すと処理が開始され、以下のような画像が生成可能です。

プロンプトの入力方法や組み合わせは多岐にわたるため、以下の記事も参考にしてみてください。

モデルの導入・選択

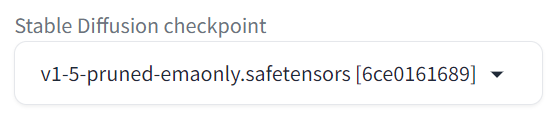

モデルは画像を学習させたデータのことで、二次元や三次元、特徴のある絵柄などさまざまなものがあります。

提供サイトがあるのでそこからダウンロードして追加すれば、左上のStable Diffusion checkpointで使用モデルを切り替えられます。

モデルを提供しているサイトや導入方法はこちらの記事を参考にしてください。

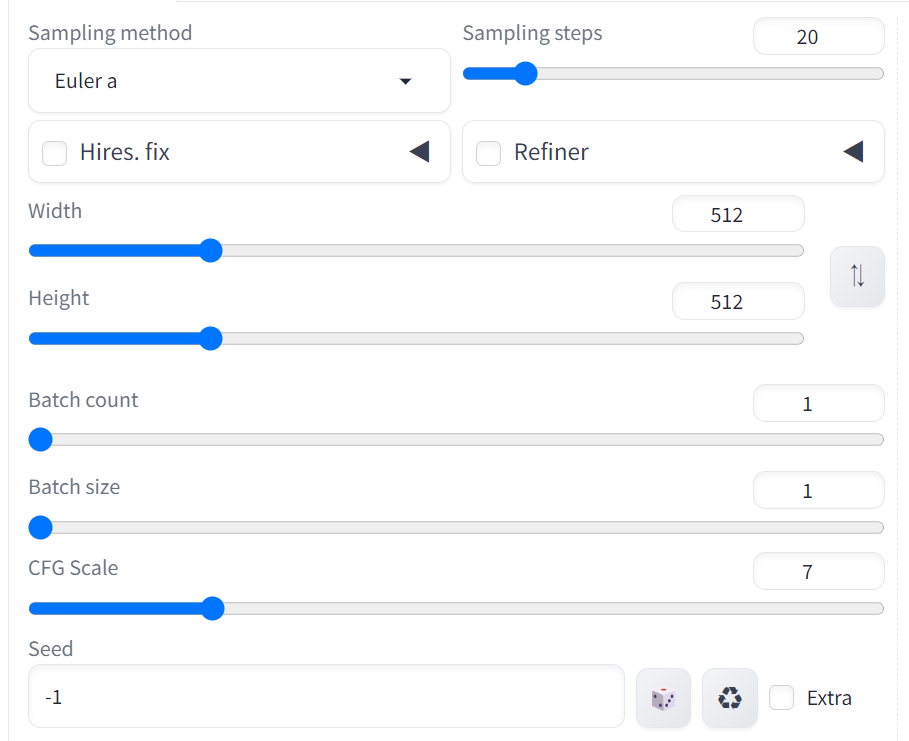

パラーメータの設定

Stable Diffusion Web UIにはさまざまなパラーメータがあり、設定次第で画像生成結果に影響がでます。

各項目で設定できるのは以下の通りです。

| Sampling method | 画像生成に使用するサンプラーを指定 |

| Sampling steps | ノイズ除去を何回を行うか |

| Width | 画像の横幅 |

| height | 画像の縦幅 |

| batch count | 画像を何枚生成するか |

| batch size | 一度に同時生成する画像の枚数 |

| CFG scale | プロンプトの影響度 |

| seed | ランダム性を制御するもの |

英文ですが具体的な比較画像が公式に載っているため、こちらのページも確認してみてください。

Features · Stable Diffusion Web UI/stable-diffusion-webui Wiki

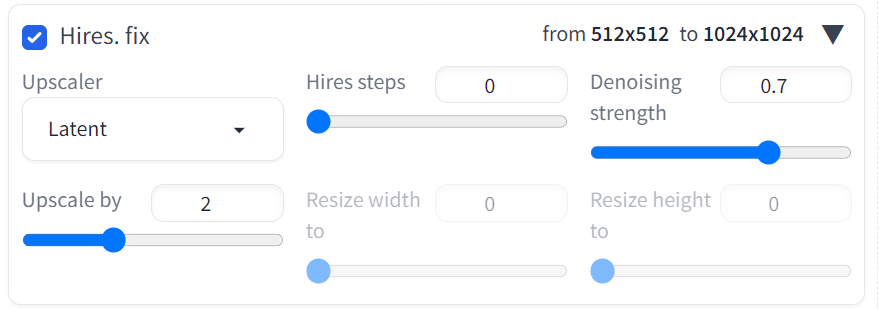

Hires.fix

Hires.fixは画像を高画質化できる機能です。

ネット上に出回っている高画質な画像のほとんどがこちらの機能を使用しています。

タブを開くと自動的にONとなり、パラーメータの設定が行えます。

チェックボックスをクリックすればタブを開いたままON・OFFが可能です。

| Upscaler | アップスケールに使用するアルゴリズム |

| Upscale by | 何倍にアップスケールするか |

| Hires steps | ノイズ除去を何回行うか ※0だとSampling stepsの値を採用 |

| Denoising strength | ノイズ除去強度 |

Hires.fixについては別途書いた記事があるので、こちらも参考にしてみてください。

公式にも解説ページがあります。

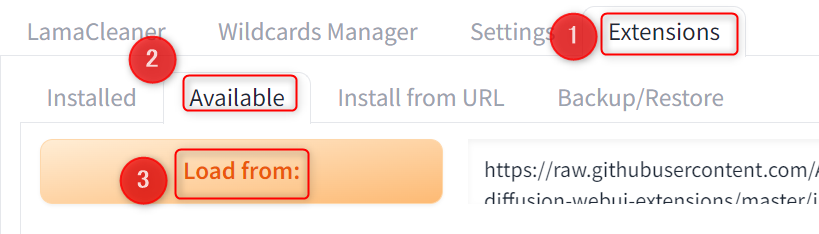

拡張機能の導入

Stable Diffusion Web UIには、よりUIを使いやすくしてくれる拡張機能が多数あります。

プロンプトの入力を補助してくれたり、AI動画を作れるようにしたり、種類はさまざまです。

導入方法は簡単で、一覧から選ぶか、URLから直接インストールできます。

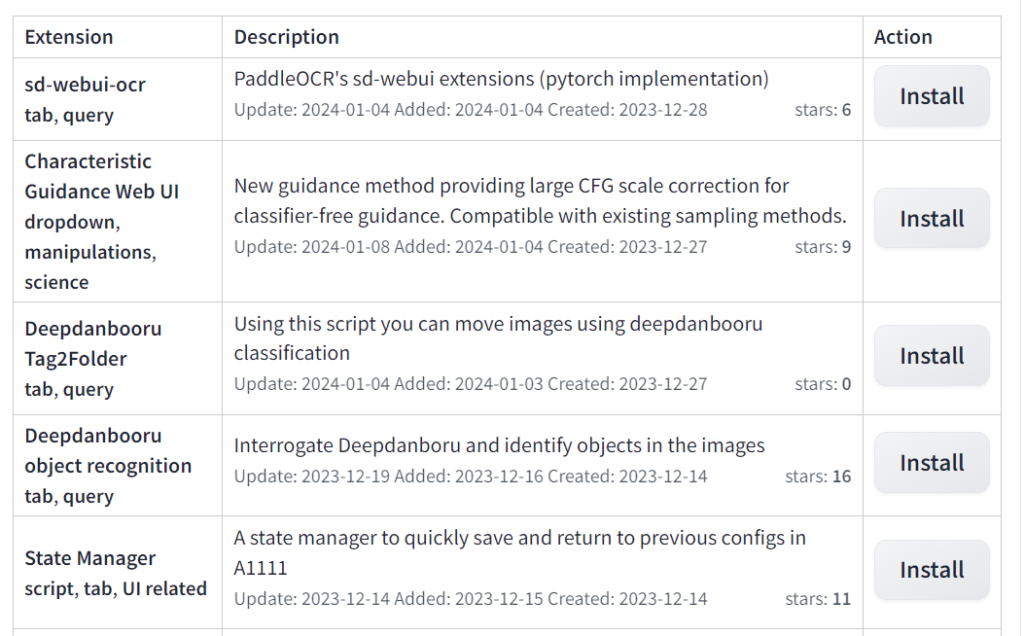

一覧から選んでインストール

Extensions→Available→Load from:をクリックすると拡張機能一覧を表示できます。

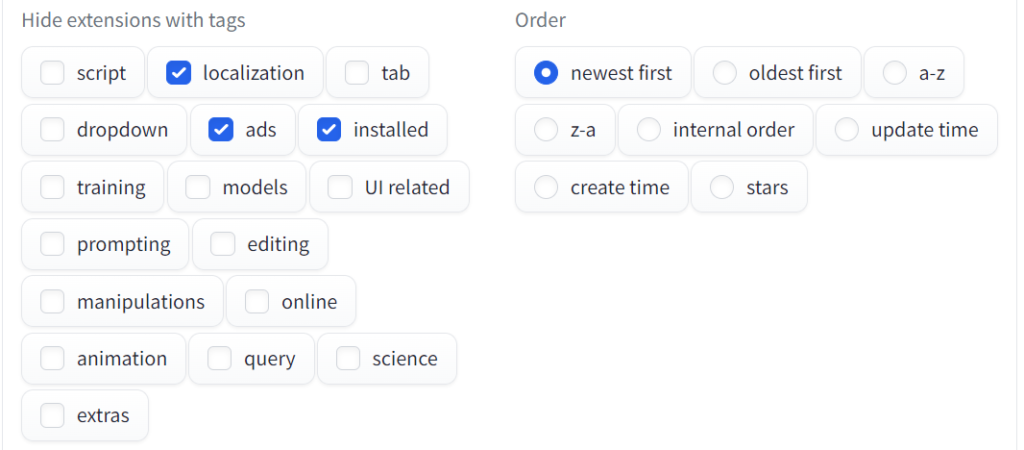

なお、下の「Hide extensions with tags」や「Order」では、絞込や並び替えが可能です。

右側のInstallボタンを押せば、拡張機能をインストールできます。

Extensionsのファイル名がリンクになっているので、どんな機能か確認したい場合はそこから公式に飛んでみてください。

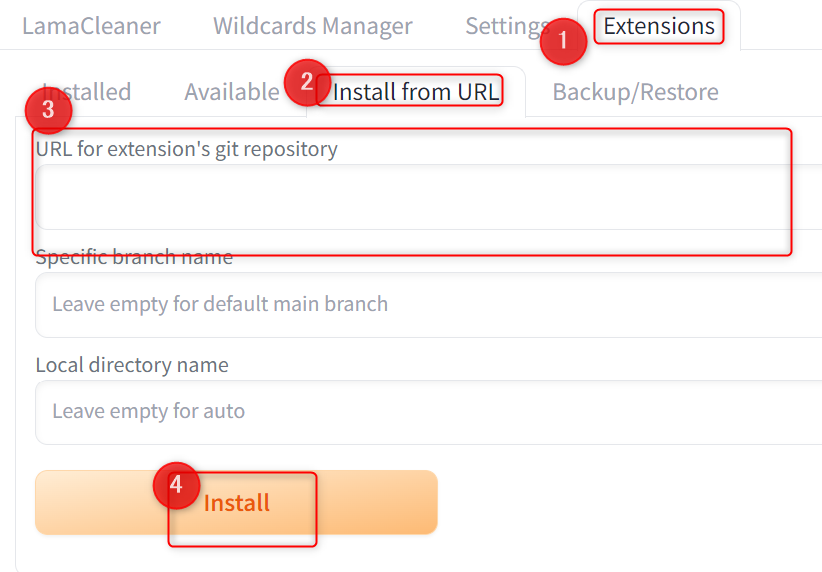

URLからインストール

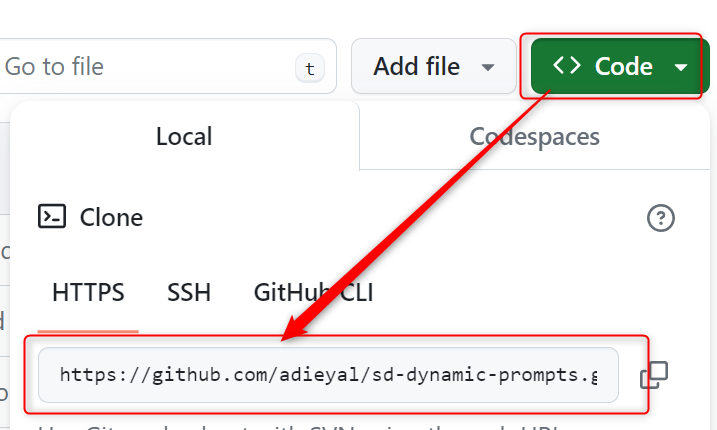

Stable Diffusion Web UIの拡張機能は大体githubで公開されています。

githubからclone用のURLをコピーして入力すれば、インストールが可能です。

例えばランダム入力ができる「sd-dynamic-prompts」をインストールする場合は、githubのページからcodeを開いて、clone用のURLをコピーします。

これをExtensions→Install from URL→URL for extension's git repositoryに入力してinstallボタンを押すだけです。

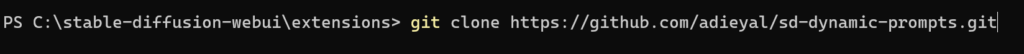

なお、同じURLを使ってターミナルからもインストールできます。

以下のパスに移動して、右クリックからターミナルを開きます。

stable-diffusion-webui\extensions「git clone」の後に取得したURLを記入して実行します。

git clone URL上記のsd-dynamic-promptsなら以下のような形です。

git clone https://github.com/adieyal/sd-dynamic-prompts.git

どの方法でインストールしても、Stable Diffusion Web UIはリスタートか再起動させてください。

設定がうまく反映されない可能性があります。

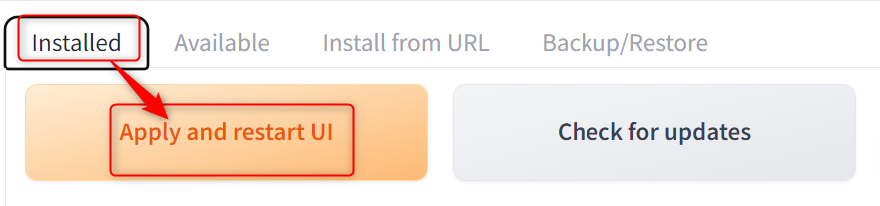

リスタートはInstalledタブのApply and restart UIから行えます。

Stable Diffusion Web UIによくあるエラーと解決方法

Stable Diffusion Web UIの導入時によくあるエラーと解決方法についてご紹介します。

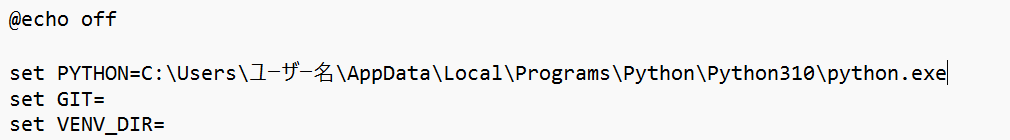

Couldn't launch pythonと表示される

これはPythonの実行ファイルが見つけられない、またはPATH環境変数が正しく設定されていない場合に起こります。

Pythonがしっかりインストールされている状態であれば、Pythonのパスを指定することで解決できる可能性があります。

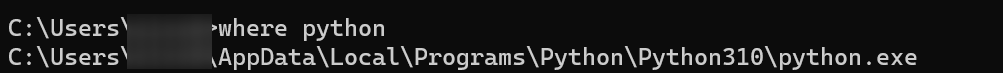

まずPythonがインストールされている場所の確認をしましょう。

Windowsの検索から「cmd」と入力して、コマンドプロンプトを起動、「where python」と入力して実行します。

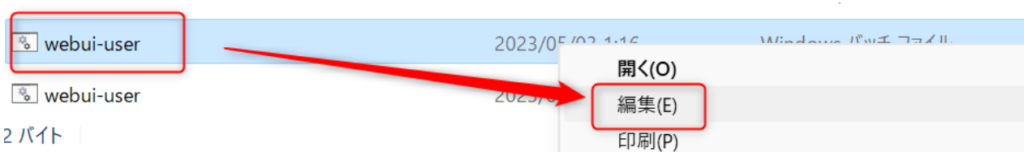

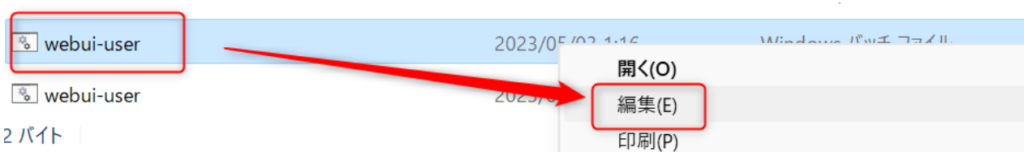

Pythonの場所がわかったので、「webui-user」を右クリックして編集を選択します。

先ほどコマンドプロンプトで表示されたパスをset pythonに入力して保存します。

この状態で再度バッチファイルを起動すれば、正常にインストールされるはずです。

Pythonインストール時に「Add python.exe to PATH」にチェックを入れていれば、通常このエラーは発生しないと思われます。

Anaconda経由など通常とは異なる方法でPythonをインストールしていると、このエラーが発生するかもしれません。

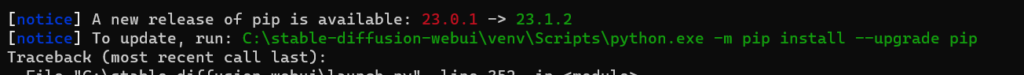

pipのアップグレードを求められる

pipのバージョンが古いため、インストールが止まってしまうエラーです。

pipはPythonパッケージの管理ツールです。

バージョンが古いと新しいバージョンのパッケージがサポートされていない場合があるため、pipのアップグレードを求められます。

こちらもコマンドプロンプトでアップグレードが可能です。

まずターミナルに書いてある通り、以下のパスでターミナルを起動します。

stable-diffusion-webui\venv\Scripts次に以下のコマンドを入力して実行します。

python -m pip install --upgrade pipアップグレードできたら再度バッチファイルを起動して、インストールを試してみてください。

なお、コマンドプロンプトで「pip --version」と入力すると現在のバージョンを確認できます。

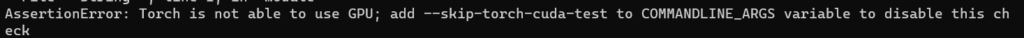

Torch is not able to use GPUというエラー

Torch is not able to use GPUと出て、インストールが止まってしまうエラーです。

これはPCのGPUがStable Diffusionに対応していないときに表示されます。

ノートPC(RadeonのGPU)にStable Diffusion Web UIをインストールしたら、このエラーが発生しました。

おそらくRadeonそのものが悪いわけではなく、古いタイプだからだと思います。

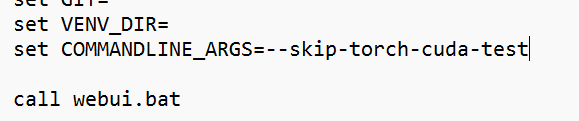

エラーに書いてある通り、バッチファイルのCOMMANDLINE_ARGSに「--skip-torch-cuda-test」と入力すると回避できます。

バッチファイルを右クリックして編集を選択します。

「set COMMANDLINE_ARGS=」の箇所に「--skip-torch-cuda-test」と入力して保存します。

これで再度バッチファイルを起動すれば、インストールできるはずです。

画像生成ができない

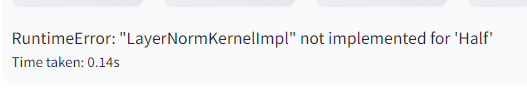

インストールはできたものの、画像を生成すると、下記のようなエラーがでて実行できない場合があります。

RuntimeError: "LayerNormKernelImpl" not implemented for 'Half'

これは使用しているGPUが半精度演算をサポートしていないことが原因です。

上記で紹介したエラーと同じく、Radeonの古いGPUで実行したらこれが出ました。

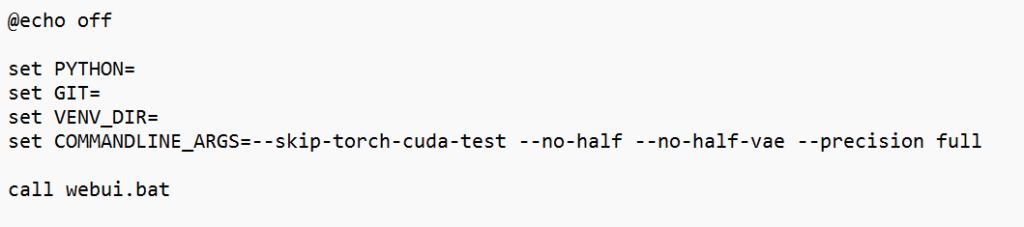

半精度演算を使わず計算させるにはバッチファイルのCOMMANDLINE_ARGSに以下を入力します。

| --no-half | ハーフ精度浮動小数点演算を無効 |

| --no-half-vae | 浮動小数点演算を単精度浮動小数点ではなく倍精度浮動小数点に変更 |

| --precision full | モデルのパラメーターを倍精度浮動小数点数(64ビット)で計算する |

COMMANDLINE_ARGSは半角スペースを入れて、複数入力ができます。

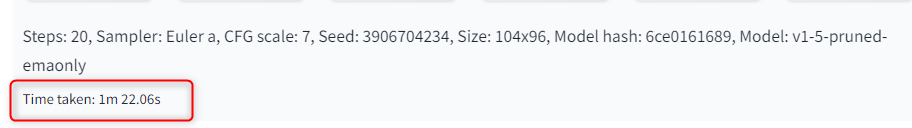

これで画像生成はできるようになりますが、104*96サイズで1分22秒かかりました。

この環境だと満足に画像生成が行えないので、GPUの交換やPCの買い替えを検討した方がいいかもしれません。

Stable Diffusion Web UIをインストールする方法まとめ

今回はStable Diffusion Web UIのインストール方法について解説しました。

- Stable Diffusion Web UIはStable DiffusionをWeb UIで動かすもの

- Python・Gitが必要

- バッチファイル「webui-user」で起動

- テキストでプロンプトを入力すると画像生成ができる

- Stable Diffusion Web UIでよくあるエラーと解決方法

興味本位で触ってみたStable Diffusionですが、どうやったら自分好みの画像が作れるか試行錯誤するのが本当に面白いです。

モデルやLoRA、さまざまな機能をインストールするといろいろなことができます。

今後画像生成AIを使って遊んだり、ビジネスに活用したりしたい方は、ぜひ挑戦してみてください。