好みの被写体が生成できたとき、同じ物で服装やポーズを変えたいと思ったことはないでしょうか?

同一人物でさまざまな画像を生成できれば、ストーリー性のある漫画作品なども作ることができます。

今回は同一人物の生成方法を3つご紹介します。

- 同一人物のポーズや服装を変えたい

- 具体的な方法がしりたい

- 同一人物の画像で何かコンテンツを作りたい

同一人物の画像を生成するとは?

今回やりたいことは、以下のように同一人物の服装、表情、ポーズなど変化させるというものです。

同一人物の画像を生成する3つの方法

それでは実際に同一人物の画像を生成する方法について解説します。

- シード値を固定してプロンプトを調整

- reference onlyで変化させる

- LoRAを作成

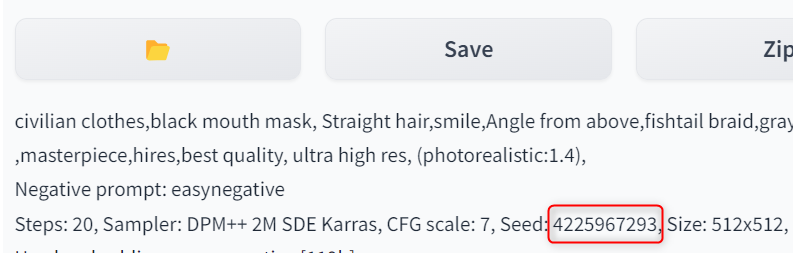

シード値を固定してプロンプトを調整

冒頭で紹介した画像はこのやり方で生成しています。

シード値はランダム性を制御できるもので、値を固定すると同じ結果を得ることができます。

シード値と特定のプロンプトを固定して、新しい要素を追加すれば、一部を固定したまま別の画像が生成できるという仕組みです。

まずは自分の好きな被写体を生成します。

※生成した画像

生成時のプロンプトから、維持したい特徴を残します。

- 髪型:wavy hair

- 髪の長さ:medium hair

- 髪色:red hair

- 目の色:blue eyes

- メガネ:black-rimmed glasses

次にシード値を固定します。

生成結果からコピペして入力、またはseedの項目にあるリサイクルアイコンをクリックすれば生成した画像のシード値が入力されます。

上記のプロンプトとシード値を固定し、表情・服装・アングルをランダム入力で追加しました。

これで同一人物のまま、表情・服装・アングルのみ変えることができます。

※ランダム要素を加えた画像

ただし、モデルによってはなかなか良い結果が得られないこともあります。

こちらはchilled_remixを使用して、一部の要素を固定し、表情・服装・アングルを変化させたものです。

・固定した要素

- 髪型:ponytail

- 髪の長さ:medium hair

- 髪色:black hair

- 目の色:brown eyes

※元画像

※固定+ランダム要素を含えた画像

髪型や雰囲気は表現できていますが、画像によっては同一人物に見えないものもあります。

このようにモデルによって生成しやすさが異なります。

同一人物を生成するコツとしては、固定する要素を細かく指定することです。

今回髪型や髪色しか固定していませんが、眉毛、目の形、唇の厚さ、体系などを具体的に指定することで、より同一人物の画像を生成しやすくなります。

また、反映されない要素に重みをつければ、再現できる可能性も上がります。

基本的なプロンプトの入力方法やランダム入力について書いた記事があるので、こちらも参考にしてみてください。

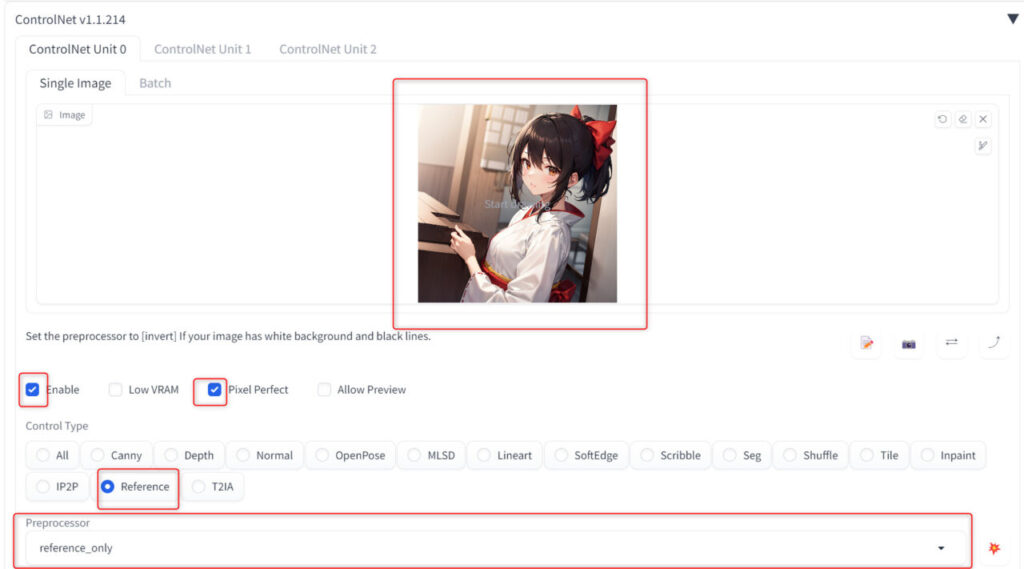

reference onlyで変化させる

reference onlyはcontrol netという拡張機能で使える機能です。

取り込んだ元画像に対して、プロンプトやシード値で変化を与えられます。

今回はこちらを元画像として使用します。

この画像をcontrol netで取り込み、プリプロセッサーをreference onlyにして、EnableとPixel Perfectにチェックを入れてから生成します。

シード値、表情・服装・アングルをランダムにして、reference onlyを通すとこのようになります。

またプロンプトを固定してシード値のみランダムにすると、同じ服装のまま異なる画像を生成でできます。

ただし、この方法はプロンプトで具体的な要素を指定していないため、どこがどう変化するかはわかりません。

※chilled_remixの比較

reference onlyだと、三次元モデルでも比較的クオリティの高い画像が生成できます。

control netのインストール方法や使い方は別記事で紹介しているので、こちらを参考にしてみてください。

LoRAを作成する

LoRAは特定のモデルに対して、別のモデルを適用できる技術です。

上記2つの方法で生成した画像を学習データとして使用すれば、自分でLoRAを作成することができます。

LoRAは学習する特徴を調整したり、モデルへの適用具合を調整したりできるため、上記2つより自由度は高めです。

今回はreference onlyのところで生成した巫女服の女性を学習させて、LoRAデータを作ってみました。

LoRAを使用して画像生成すると、髪色、髪型・服装を変化させても、被写体の特徴を維持することができます。

また異なるモデルでも、LoRAを使えば特徴的な部分を再現できます。

なお、LoRA使用時も再現したいプロンプトの入力が必要です。

例えば巫女服の女性は髪型を「ponytail」、巫女服を「kimono and red hakama」で指定しています。

これらを再現したい場合は、LoRA使用時も「ponytail」「kimono and red hakama」を入力します。

LoRA+特徴的な部分のプロンプトを入力することで、再現率を上げることが可能です。

LoRAの作成方法や使い方については別記事で解説していますので、こちらを参考にしてください。

同一人物の画像を生成する3つの方法まとめ

今回は同一人物の画像を生成する方法について、解説しました。

- シード値を固定してプロンプトを調整

- reference onlyで変化させる

- LoRAを作成する

これらの方法である程度特徴を維持することはできますが、再現性を上げるにはプロンプトなどで微調整が必要です。

なかなか思った通りの結果を得られないこともあるため、根気強く生成してみてください。

参考になれば幸いです。